Barrieren beim Suchen und Finden

Bibliothekare verwenden sehr viel Zeit darauf, ihre Werke so zu ordnen, dass sie möglichst einfach aufgefunden werden können und dennoch einem gewissen Ordnungs-Schema unterworfen sind, das nicht zu feingliedrig, aber auch nicht zu eng angelegt ist. Am Ende der Ordnungskette bleibt der Titel des Werkes oder noch weiter im Detail ein einzelner Artikel in eben jenem Werk. Anhand dieser Informationen kann man die gewünschte Information sehr präzise ausfindig machen, wenn alle Werke nach dem gleichen Schema archiviert wurden.

Mit der rasant wachsenden Anzahl von Informationen, die eng mit dem Wachstum des Internets verbunden ist, wird die eindeutige Identifizierbarkeit und Auffindbarkeit von digitalen Inhalten auch im Alltag zunehmend interessanter. Nicht ohne Grund tauchen daher plötzlich Begriffe wie "Semantisches Web" und "Tagging" immer häufiger auch abseits der IT-Branche auf.

Such- und Findmaschinen

Bereits mit dem Auftreten der ersten Suchmaschinen (Crawler), die selbsttätig Internetseiten aufsuchten und indizierten, wurde der Grundstein für neue Wege zum Auffinden von Informationen gelegt. Anhand von Meta-Informationen, von denen wohl die Suchbegriffe (Keywords) und die Seitenbeschreibung (Description) die größte Popularität erlangt haben, wurden Internetseiten und deren Inhalte ausfindig gemacht und in den Datenbanken der Suchmaschinen gespeichert. Diese Verschlagwortung mit Meta-Angaben sollte dem Benutzer von Suchmaschinen dabei helfen, den richtigen Inhalt, sprich: die richtige Seite, aufzufinden. Schade nur, dass dubiose Geschäftemacher diesen Trend ins Gegenteil verkehrten und somit gleichermaßen die Geburtsstunde des Spam einläuteten: Suchmaschinen wurden mit Meta-Informationen geradezu geflutet, auch wenn die wirklichen Inhalte weit entfernt von den Meta-Angaben waren.

Moderne Suchmaschinen arbeiten anders. Hier zählen andere Faktoren, auch wenn diverse Meta-Informationen immer noch ausgewertet werden. Im Vordergrund steht heute die Popularität der Seite, die von Suchmaschinen - vereinfacht gesprochen - dadurch ermittelt wird, dass im eigenen Index geschaut wird, welche anderen Websites auf eine bestimmte Website verweisen und wie "wertvoll" diese Internetseiten von der Suchmaschine bewertet werden. Wie dieser Wert sich im Einzelnen zusammensetzt, das ist natürlich streng geheim. Es grassieren zahlreiche Sagen, Mythen und Fabeln, was Suchmaschinen mögen und was man auf keinen Fall tun darf. Die Hommingberger Gepardenforelle ist aus diesem Grund entstanden, denn auch sie ist ein Fabelwesen, das vom Heise-Verlag ins Leben gerufen wurde, um festzustellen, wie Suchmaschinen arbeiten und was wirklich zählt. Kurz gesagt: Wie man Suchmaschinen und Findmaschinen macht.

Beim Wort genommen

Eine neue Entwicklung ist das Semantische Web, dessen Ursprünge auf Tim Berners-Lee zurückgehen, der bereits bei der Entstehung des World Wide Web seine Finger im Spiel hatte. Konkret geht es darum, das WWW um maschinenlesbare Daten zu erweitern, die eine formale Festlegung der Semantik, basierend auf den Inhalten, herbeiführen soll. Oder einfacher gesagt: Die Inhalte sollen auch für Maschinen eine Bedeutung erhalten, so dass beispielsweise eine Überschrift auch als solche erkannt wird und ein Zitat ebenfalls als solches identifiziert werden kann. Der Begriff des Semantischen Web orientiert sich an der Bedeutung des Wortes Semantik, die Wikipedia wie folgt erklärt:

Die Semantik (Bedeutungslehre) ist das Teilgebiet der Sprachwissenschaft (Linguistik), das sich mit Sinn und Bedeutung von Sprache beziehungsweise sprachlichen Zeichen befasst. Die Semantik kümmert sich um die Frage, wie Sinn und Bedeutung von komplexen Begriffen aus denen von einfachen Begriffen abgeleitet werden können und stützt sich dabei in der Regel auf die Syntax.

Auch für ein barrierefreies Internet ist diese Semantik von großer Bedeutung, denn moderne Ausgabegeräte vom Browser bis zur Sprachausgabe können diese semantischen Informationen ebenfalls auswerten. Gleiches gilt natürlich für Suchmaschinen, die ihre Bewertungs- und Ranking-Verfahren um semantische Aspekte anreichern werden.

Auffindbarkeit im Hier und Jetzt

Doch wenn all das Zukunftsmusik ist und das ein oder andere Projekt rein wissenschaftlich bereits gestartet wurde, was kann man dann tun, um Ordnung in seine Informationen zu bringen, zumindest in jene, die man online publiziert? Wiederum hat die Blog-Gemeinde hier die Nase vorn. Ähnlich wie im Fall der Standardkonformität oder dem Verzicht auf Layout-Tabellen ist die Blogger-Community in Punkto Informations-Archivierung den Großen der Branche voraus. Kein Wunder, denn das tägliche Veröffentlichen von Artikeln, Link-Tipps und mehr aus allen möglichen Bereichen des Lebens erfordert Strukturen und Orientierungshilfen.

Das fängt an bei der Kategorisierung von Inhalten nach bestimmten Themengebieten. Kaum eine Weblog-Software, die ohne Kategorien oder Sektionen auskommt. Der Fachmann spricht hier von Taxonomie. Auf diese Weise können Inhalte einer bestimmten Kategorie oder gleich mehreren auf einmal zugeordnet werden. Das Prinzip erinnert ein wenig an die bewährte Portal-Technik von Yahoo! oder DMOZ, denn Kategorien und Unterkategorien gibt es hier bereits seit den Anfängen des grafischen Internet. Das hilft dabei, Inhalte nach Themengebieten zu erfassen. Viele Weblogs bieten zudem die Möglichkeit, ein Archiv nach Datum sortiert aufzubauen. Wohlgemerkt: als zusätzliche Option. So kann man Einträge auffinden, die einer bestimmten Epoche zuzordnen sind, wie beispielsweise Olympische Sommerspiele oder andere zeitlich begrenzte Ereignisse.

Damit aber nicht genug, denn Blogger sind wahre Gurus der Informationsverwaltung! Frühzeitig hat sich eine Technik durchgesetzt, die unter dem Namen "Tagging" bekannt wurde und an deren Spitze die Suchmaschine von Technorati steht. Mit Hilfe von Tags, die man sich vereinfacht als virtuelle Etiketten vorstellen kann, werden Inhalte zusätzlich kategorisiert. Was Tagging im Einzelnen ist und wie es funktioniert, kann man in einem Weblog-Artikel von Markus Breuer nachlesen, der soziale Aspekte des Tagging ebenso berücksichtigt, wie die Ordnung stiftende Funktion dahinter.

Saubere Sache: Sprechende URLs

Wer dem Link in die Provinz gefolgt ist, der sieht auf den zweiten Blick noch eine Ordnungs-Einheit, die erst durch Weblogs wieder populär wurde. Die Rede ist von sprechenden URLs, gerne im angelsächsischen Sprachgebrauch auch als Clean URLs bezeichnet. Wiederum eine Rückbesinnung auf alte Tugenden, denn in den Anfängen des Internet hatten URLs, da zumeist von Hand erzeugt, noch eine gewisse Aussagekraft. Mit dem Aufkommen von Content Management Systemem und der zunehmenden Dynamisierung von Websites ging dies allerdings schnell verloren. Fortan sahen URLs zumeist so aus:

/ibot/db/press1.Theda_1119351159.html

Welches Thema sich dahinter verbirgt, von wann der Eintrag ist und ob das Thema überhaupt von Interesse ist, kann man dieser Form von URL nicht entnehmen. Der Informationsgehalt ist gleich null. Höchstens eingefleischte Kenner und Redakteure wissen vielleicht etwas damit anzufangen. Besser organisiert zeigen sich die meisten Blog-Einträge:

/aus_der_provinz/2004/09/was_ist_tagging.html

Spontan erkennt selbst ein unwissender Leser dieser URL, dass es sich um einen Beitrag aus dem Jahr 2004 handelt, vermutlich aus dem September und der Dateiname läßt vermuten, dass es um die Frage "Was ist Tagging?" geht. Diese Form der URL nennt man daher auch sprechend, denn sie erklärt sich selbst. Für die Barrierefreiheit von Websites sind sprechende URLs ein absolutes Muss, wie auch Marcus Völkel in seinem Weblog betont. Nicht etwa, weil es die BITV in Bedingung 13.1 so vorschreibt, sondern weil der Benutzer etwas davon hat. Am Ende aller Bemühungen sollte immer der Nutzer stehen.

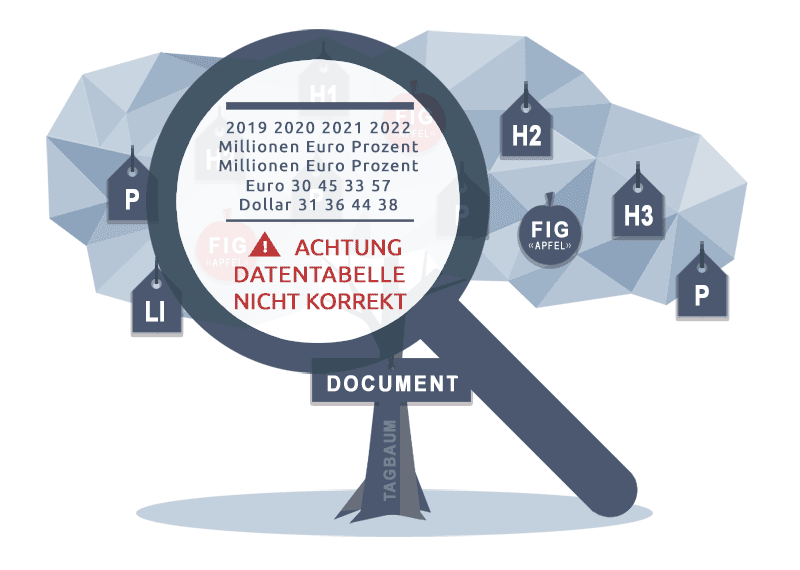

Kategorisierte Informationen, aussagekräftige URLs, Meta-Angaben und Tagging sind bereits heute gute Möglichkeiten, um Inhalte leichter auffindbar zu gestalten. Dazu gehört auch ein deskriptiver Titel für das Dokument, die sinnvolle Verwendung von Markup-Elementen (zum Beispiel h1 für eine Überschrift der ersten Ordnung) und die saubere Trennung von Inhalt und Verpackung bei Websites. Einigen Websites würde es aber gut zu Gesicht stehen, wenn sie zumindest saubere URLs verwenden würden, denn dieser Teil ist relativ einfach zu bewerkstelligen - vorausgesetzt, die zugrunde liegende Technologie stimmt.

BITV-Test und Beratung

Wir sind bereits mehrere Jahre offizielle Prüfstelle im BITV-Test-Prüfverbund und können Ihnen den BIK BITV-Tests anbieten – entweder als Konformitätstest (BITV-Test zur Veröffentlichung) oder einen Projekt begleitenden BITV-Test, der aufgrund einer geringeren Seitenauswahl (Stichprobe) zwar günstiger ist, aber nicht veröffentlicht werden darf. Sprechen Sie uns an, wir erstellen Ihnen gerne ein unverbindliches Angebot für einen BIK BITV-Test. Neben diesen Tests können wir Ihnen auch eine vereinfachte Überprüfung sowie unseren eigenen Barriere-Check Pro (erweiterter BITV-Test) anbieten

Barrierefreie PDF

Von uns erhalten Sie garantiert barrierefreie PDF. Alle Dokumente werden mit Screenreader und dem PDF Accessibility Checker überprüft und validiert. Auf Wunsch erhalten Sie auch einen Prüfbericht von uns.

Barrierefreies Internet

Als Agentur für Universelles Design und Herausgeber des Barrierekompass, hat anatom5 seit 2003 eine weitreichende Expertise im Bereich barrierefreie Informationstechnologie erlangt.

Spezialisierte BITV-Agentur

Die Leistungsfelder umfassen das gesamte Thema Barrierefreiheit nach BITV: Barrierefreies Internet, Barrierefreie PDF, Barrierefreies Responsive Design, Usability & Accessibility Konzeption, Leichte Sprache, Einfache Sprache, UI-Design, BITV-Testing, Schulungen und Workshops.

Ausgezeichnete Barrierefreiheit

Die intensive Beschäftigung mit digitaler Barrierefreiheit spiegelt sich auch in diversen Auszeichnungen wider, die anatom5 seit 2003 erhalten hat, darunter 10 Nominierungen für einen BIENE-Awards der Aktion Mensch.